强大人工智能即将来临而我们尚未做好准备

【本文翻译自纽约时报】

我对人工智能持有以下观点:

过去几年,人工智能系统已在多个领域超越人类,如数学、编程和医疗诊断等,并且其能力还在持续提升。

预计在不久的将来——或许是2026年或2027年,甚至可能就在今年——将有一个或多个人工智能公司宣称已研发出通用人工智能(A.G.I.),即一种能执行几乎所有人类认知任务的通用人工智能系统。

当A.G.I.问世时,可能会引发关于其定义的争议,以及它是否能被称为“真正的”A.G.I.的讨论。然而,这些争论可能并不重要,因为更关键的一点是:我们正失去对人类水平智能的独占权,并迈向一个拥有强大人工智能系统的世界,而这将是不可否认的事实。

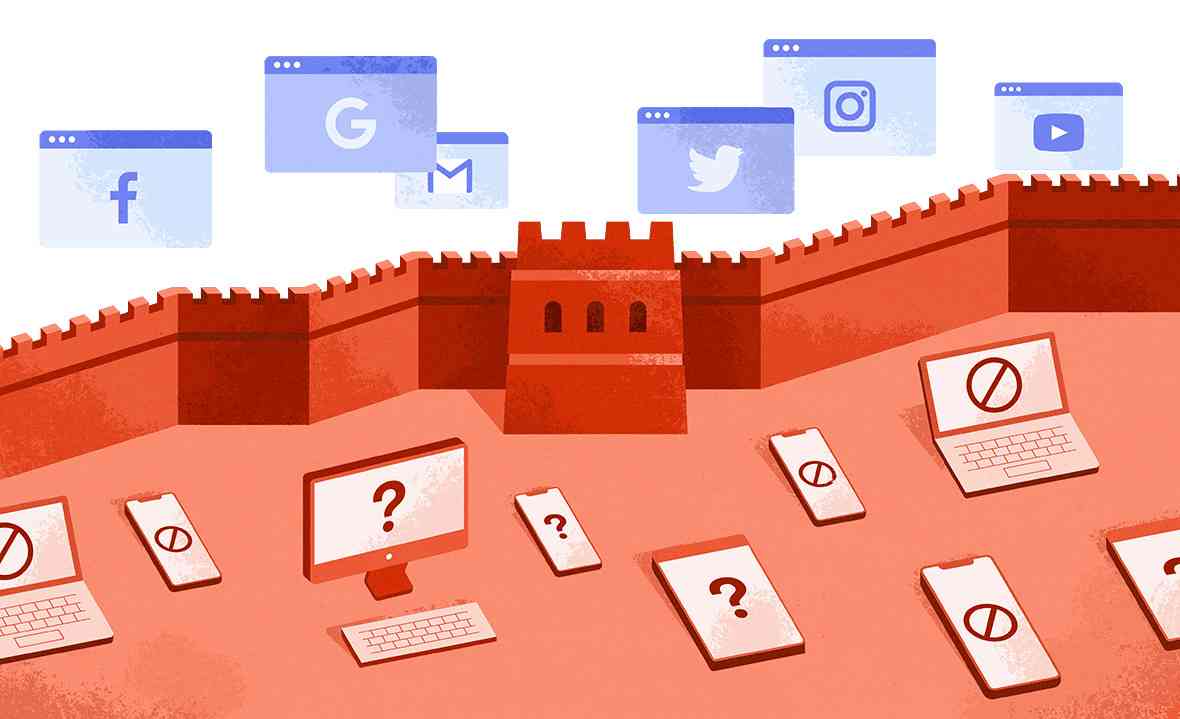

在未来十年内,强大的人工智能将创造数万亿美元的经济价值,并使政治和军事力量的天平向掌握这项技术的国家倾斜。事实上,大多数政府和大型企业已经意识到这一点,他们正投入巨额资金以期率先取得突破。

我认为,大多数个人和机构对现有的人工智能系统都毫无准备,更不用说未来更强大的系统了。目前,各级政府都没有切实可行的计划来应对这些系统带来的风险或获取其益处。

那些坚决怀疑人工智能发展的人——他们认为所谓的进展只是虚假的表象,并将通用人工智能(A.G.I.)视为一种不切实际的幻想——不仅在观点上是错误的,还误导了公众,使其产生虚假的安全感。

无论你认为A.G.I.对人类是福是祸——坦率地说,现在下定论可能还为时过早——它的出现都带来了重要的经济、政治和技术问题,而我们目前还没有明确的答案。

我坚信,现在是开始为A.G.I.做准备的最佳时机。

这些观点可能听起来有些疯狂,但我并非作为一名空想的未来主义者、一个吹嘘自己人工智能投资的投资者,或是一个因迷幻蘑菇和《终结者2》而产生幻觉的人得出这些结论的。

作为一名记者,我通过与构建强大人工智能系统的工程师、投资于该领域的投资者以及研究其影响的研究人员的深入交流,逐渐形成了这些观点。我深信,当前人工智能领域的发展远超大多数人的理解。

在我所在的旧金山,A.G.I.的概念并不被视为边缘或奇特。人们常谈论“感受到A.G.I.”,而构建超越人类智能的人工智能系统已成为硅谷一些巨头公司的明确目标。每周,我都会遇到从事人工智能工作的工程师和企业家,他们告诉我,一场巨大的、颠覆性的变革即将到来,这是我们从未经历过的。

独立人工智能政策研究员Miles Brundage(去年离开OpenAI)最近告诉我:“在过去的一两年里,曾经被称为‘短期实现’的观点(即认为A.G.I.可能在本十年内建成)已几乎成为共识。”

然而,在湾区之外,很少有人听说过A.G.I.,更不用说开始为此做准备了。在新闻行业,那些认真对待人工智能进展的记者仍可能被嘲笑为轻信者或行业代言人。

我理解这种反应。尽管人工智能系统已为诺贝尔奖的突破做出贡献,每周有4亿人使用ChatGPT,但人们在日常生活中遇到的许多人工智能应用仍令人困扰。我同情那些在Facebook上看到大量人工智能生成的垃圾信息,或在与客户服务聊天机器人互动时感到笨拙的人,他们可能会想:这就是将要改变世界的技术吗?

我曾经也对这个想法持怀疑态度,但现在我意识到我错了。有几件事让我更加重视人工智能的发展。

▍ 业内人士深感忧虑

当前人工智能行业最令人不安的现象是,那些最接近这项技术的人——领先人工智能实验室的员工和高管——往往也是最担心其迅猛发展的人。

这与以往的情况大不相同。回顾2010年,当我报道社交媒体的崛起时,Twitter、Foursquare或Pinterest的内部人士并没有警告他们的应用可能引发社会动荡。马克·扎克伯格也没有测试Facebook是否可能被用于制造新型生物武器或进行自主网络攻击。

然而,如今那些对人工智能进展最为了解的人——那些构建强大人工智能系统的人,他们能够接触到比公众所见更先进的技术——纷纷表示,巨大的变革即将来临。领先的人工智能公司正在积极为通用人工智能(A.G.I.)的到来做准备,并研究其模型可能具备的令人担忧的特性,例如策划和欺骗的能力,以应对这些系统日益增强的能力和自主性。

OpenAI的首席执行官萨姆·奥特曼曾写道:“指向A.G.I.的系统已初现端倪。”

Google DeepMind的首席执行官德米斯·哈萨比斯认为,A.G.I.可能在“三到五年内”实现。

Anthropic的首席执行官达里奥·阿莫迪(尽管他不喜欢A.G.I.这个术语,但认同其基本理念)上个月告诉我,他认为我们距离拥有“大量在几乎所有方面都远超人类智能的人工智能系统”仅有一两年的时间。

或许我们应该对这些预测持谨慎态度。毕竟,人工智能高管可能从夸大的A.G.I.炒作中获益,并可能有夸大其词的动机。

然而,许多独立专家——包括全球最具影响力的人工智能研究人员杰弗里·辛顿和约书亚·本吉奥,以及拜登政府的顶级人工智能专家本·布坎南——都持类似观点。还有众多其他知名经济学家、数学家和国家安全官员也表达了相似的看法。

公平地说,一些专家对A.G.I.的即将到来表示怀疑。但即使我们忽略所有在人工智能公司工作或对结果有既得利益的人,仍有足够多的可信独立声音认为A.G.I.的实现时间可能很短,因此我们应该认真对待这些观点。

▍ 人工智能模型持续优化

对我而言,与专家观点同样具有说服力的是,当前的人工智能系统正在以显而易见的方式迅速改进,任何使用者都能感受到这种变化。

2022年,当OpenAI推出ChatGPT时,领先的人工智能模型在基本算术上表现不佳,经常在复杂推理问题上出错,还时常“产生幻觉”,即编造不存在的事实。虽然那个时代的聊天机器人在恰当的提示下能完成一些令人印象深刻的任务,但人们绝不会将它们用于任何关键性工作。

如今,人工智能模型已取得了显著进步。专用模型在国际数学奥林匹克竞赛中已达到奖牌水平,而通用模型在解决复杂问题上的能力提升如此之大,以至于我们需要设计新的、更难的测试来评估它们。虽然幻觉和事实错误仍偶有发生,但在新模型中已变得较为罕见。许多企业现已足够信任人工智能模型,将其集成到核心的、面向客户的功能中。

部分改进源于规模效应。在人工智能领域,使用更多数据和计算资源训练的更大模型通常能带来更好的结果,而当前的领先模型在规模上已远超以往。

然而,这些进步也得益于人工智能研究人员近年来取得的突破,尤其是“推理”模型的出现。这些模型在给出响应前会进行额外的计算步骤。

推理模型,如OpenAI的o1和DeepSeek的R1,通过强化学习进行训练,旨在解决复杂问题。这种技术曾用于教会人工智能以超越人类水平的方式下围棋。它们似乎在以往模型容易出错的领域取得了成功。例如,OpenAI发布的标准模型GPT-4o在极其困难的竞赛数学问题集AIME 2024上得分为9%,而几个月后发布的推理模型o1在同一测试中得分高达74%。

随着这些工具的不断改进,它们在各种白领知识工作中的应用越来越广泛。我的同事Ezra Klein最近表示,ChatGPT的Deep Research(一项生成复杂分析简报的高级功能)的输出质量“至少达到了”他合作过的人类研究人员的“中等水平”。

在我的工作中,我也发现了许多人工智能工具的实用之处。虽然我不使用人工智能来撰写专栏,但我会用它来准备采访、总结研究论文,以及构建个性化应用程序来协助处理行政任务。这些在几年前都是无法实现的。我认为,任何经常使用这些系统进行严肃工作的人,都不太可能认为它们的发展已陷入停滞。

若想真正了解人工智能近期的进步有多大,不妨与一位程序员交流。一两年前,人工智能编码工具虽然存在,但主要目的是提高人类编码人员的效率,而非取代他们。如今,软件工程师告诉我,人工智能已为他们完成了大部分实际编码工作,他们越来越觉得自己的职责是监督人工智能系统。

Y Combinator(一家初创企业加速器)的合伙人Jared Friedman最近透露, 该加速器当前批次的初创企业中有四分之一几乎完全依赖人工智能来编写代码。

他说:“一年前,他们会从头开始构建产品,但现在其中95%都是由人工智能完成的。”

▍ 过度准备优于准备不足

秉持认知谦逊的态度,我必须承认,我和许多人可能对A.G.I.(通用人工智能)的到来时间判断有误。

或许人工智能的发展会遭遇我们未曾预料的瓶颈,比如能源短缺限制了人工智能公司建设更大的数据中心,或者用于训练人工智能模型的强大芯片供应受限。也可能当前的模型架构和训练技术无法引领我们直达A.G.I.,需要更多突破性进展。

然而,即使A.G.I.的到来比我预期的晚十年——比如2036年而非2026年——我依然坚信,我们现在就应开始为此做准备。

关于机构如何应对A.G.I.的建议,大多归结为我们本就应采取的措施:升级能源基础设施,强化网络安全防御,加快人工智能设计药物的审批流程,制定法规以防范最严重的人工智能风险,在学校普及人工智能素养教育,并优先发展社会和情感技能,而非那些即将过时的技术技能。这些举措无论是否有A.G.I.的到来,都是明智之选。

一些科技领袖担心,对A.G.I.的过早担忧可能导致我们对人工智能的监管过于严苛。然而,特朗普政府已表明其希望加速人工智能的发展,而非放缓。此外,投入到下一代人工智能模型研发的资金已高达数千亿美元,且还有更多资金在筹备中,因此领先的人工智能公司不太可能自愿减缓发展步伐。

我也不担心个人对A.G.I.的过度准备。在我看来,更大的风险在于,大多数人可能要等到强大的人工智能直接影响到他们的生活——比如夺走他们的工作、使他们陷入骗局、伤害他们或他们所爱的人——才会意识到它的存在。这与社交媒体时代的情况类似,当时我们未能及时认识到Facebook和Twitter等工具的风险,直到它们变得过于庞大和根深蒂固,难以改变。

因此,我认为现在就应认真对待A.G.I.的可能性,即使我们无法准确预测它何时到来或具体呈现何种形态。

如果我们选择否认或忽视,我们可能会错失在这项技术最关键的时刻塑造它的机会。

共有 0 条评论